Un equipo de la Universidad de Lund, en colaboración con el Instituto Tecnológico de Massachusetts (MIT), ha creado pequeños animales virtuales que pasan de ser totalmente ciegos a desarrollar ojos funcionales por sí mismos dentro de un ordenador. Sin que nadie les dijera cómo debía ser un ojo, la simulación reprodujo pasos clave de la evolución real de la visión y generó estructuras equivalentes a ojos de cámara y ojos compuestos.

Para quien se pregunte qué significa esto en la práctica, la idea es sencilla aunque el trabajo por detrás no lo es. Los investigadores han construido un mundo digital donde habitan criaturas artificiales. Al principio solo perciben luz de forma muy burda. Con el paso de muchas generaciones, y bajo presión para sobrevivir en ese entorno, terminan desarrollando sistemas visuales cada vez más sofisticados.

Cómo se diseñó este mundo de evolución artificial

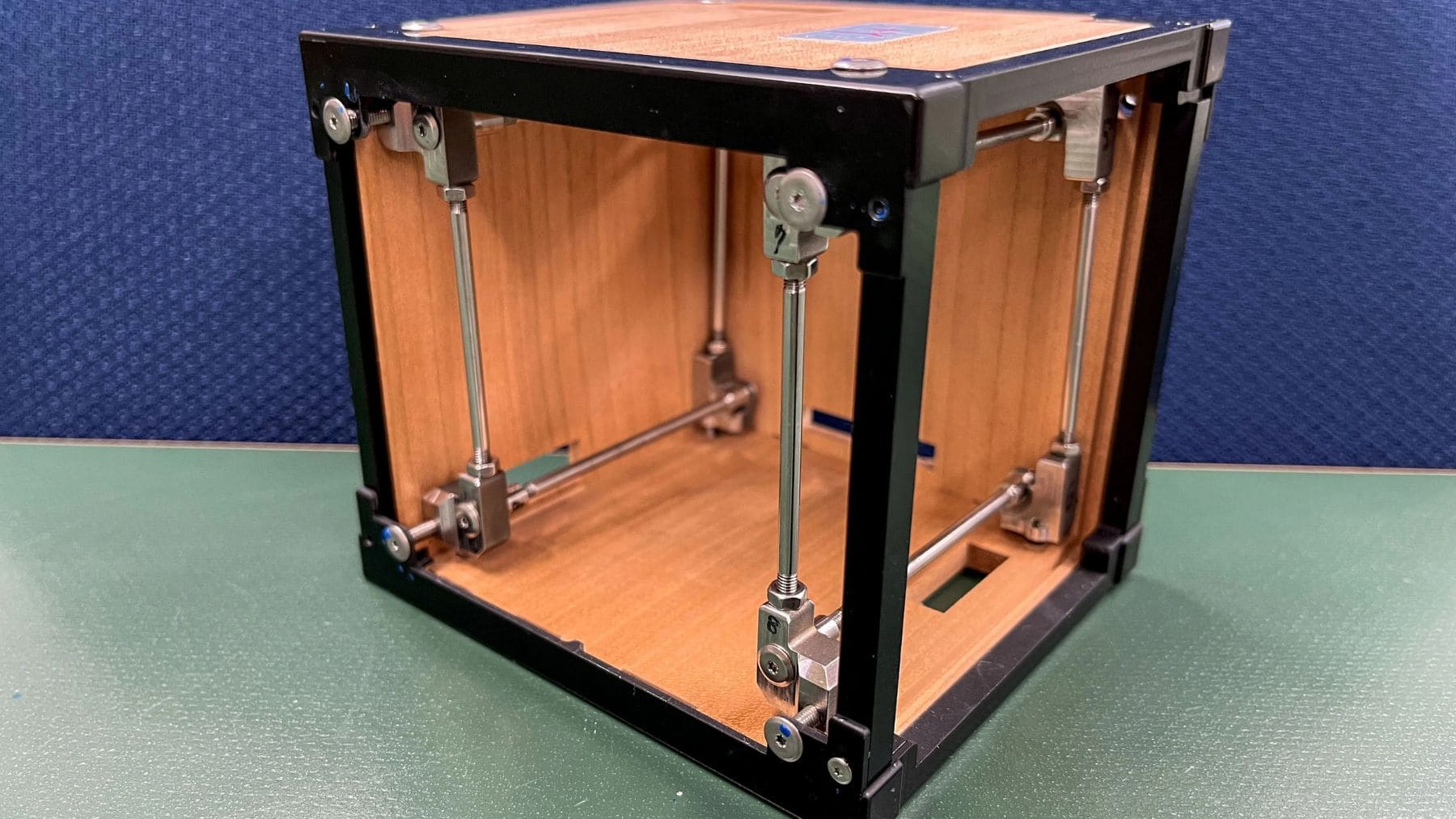

Las criaturas son agentes de IA corporizada, es decir, programas que no solo calculan sino que también tienen un «cuerpo» virtual con el que se mueven, chocan, giran y buscan recursos dentro de un escenario simulado.

Los científicos les asignaron tareas muy básicas como orientarse en un laberinto, esquivar obstáculos y encontrar «comida» mientras evitan zonas venenosas. Cada agente tiene un «genoma» digital que codifica la forma y disposición de sus ojos, sus propiedades ópticas y la red neuronal que procesa la imagen. Ese genoma sufre pequeñas mutaciones aleatorias. Las criaturas que lo hacen mejor en las tareas dejan más copias de su código y las peores desaparecen, igual que en la selección natural.

De esta forma, la evolución no se programa paso a paso. El equipo solo fija las reglas del juego y deja que la combinación de variación y competencia haga el resto.

De simples puntos de luz a ojos complejos

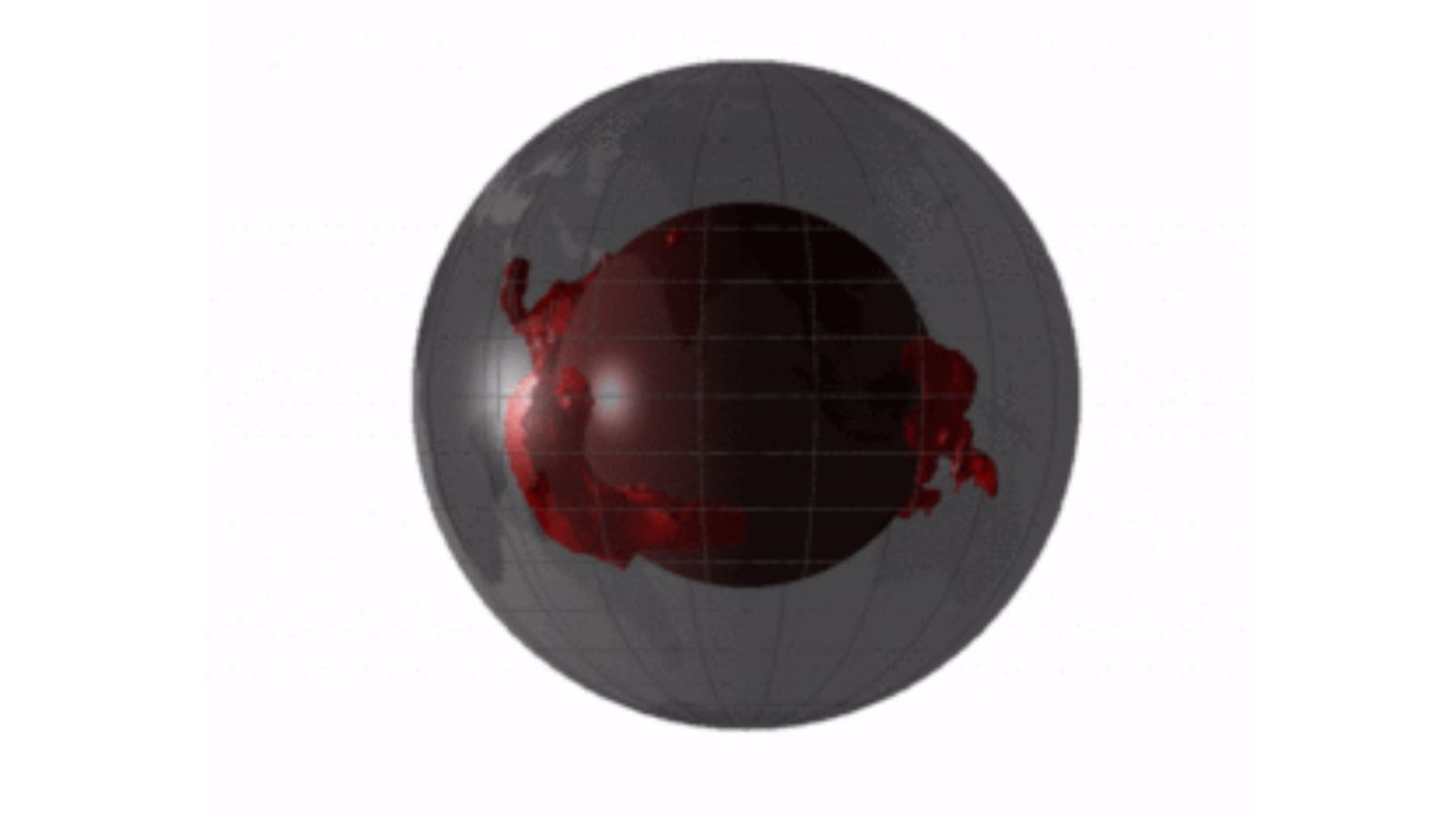

Al principio aparecen estructuras muy simples que solo distinguen si hay luz o no. Con el tiempo, estas manchas sensibles se organizan en arreglos espaciales que permiten saber de dónde llega la luz y, más adelante, diferenciar formas. En el estudio se observaron tres soluciones conocidas de la naturaleza que surgieron por separado dentro del ordenador ojos similares a parches de fotorreceptores dispersos, ojos tipo cámara con alta definición y ojos compuestos formados por muchas unidades pequeñas.

Lo interesante es que el tipo de ojo que evoluciona depende de la tarea. Según el trabajo, cuando la prioridad es navegar y orientarse en un entorno complejo, la evolución digital favorece configuraciones tipo ojo compuesto, que cubren un gran campo visual. En cambio, cuando lo importante es distinguir bien un objeto concreto, como diferenciar comida de veneno, la simulación tiende a «inventar» ojos de cámara con mayor agudeza.

Como resume el biólogo evolutivo Dan-Eric Nilsson, han logrado una «evolución artificial que produce resultados muy similares a los de la vida real» y es la primera vez que se sigue cómo aparece un sistema visual completo sin decirle al ordenador cómo debe construirlo.

Mucho más que un truco de laboratorio

El trabajo sirve, en primer lugar, para probar hipótesis sobre la evolución de la visión que en la naturaleza son imposibles de comprobar. No podemos rebobinar millones de años de historia ni cambiar a voluntad el entorno de un animal real. En un mundo digital sí se puede ajustar la dificultad de las tareas, la iluminación o la presencia de depredadores simulados y ver qué tipo de ojos aparecen en cada caso.

Además, el estudio identifica patrones de escala entre la agudeza visual y la capacidad de procesamiento neuronal. A medida que las tareas se vuelven más complejas, las criaturas que mejor se adaptan son las que combinan más resolución en sus ojos con redes neuronales internas más grandes. Esa relación entre sensores y «cerebro» puede ayudar a diseñar cámaras y sistemas de visión artificial que aprovechen mejor cada píxel en aplicaciones robóticas o industriales.

También hay un mensaje de cautela. Estas criaturas no son seres vivos ni tienen experiencia consciente. Son modelos simplificados que capturan una parte de los procesos reales. El entorno digital es mucho menos variado que un ecosistema natural y, aun así, la evolución converge en soluciones parecidas. Eso sugiere que ciertas «recetas» ópticas son especialmente eficaces, pero no significa que el estudio haya agotado todas las posibles formas de ver.

Qué viene ahora y por qué te debería importar

Más allá de la curiosidad tecnológica, este tipo de simulaciones abre una vía para entender por qué la vida en la Tierra ha tomado unos caminos y no otros. Ayuda, por ejemplo, a explicar por qué los ojos de cámara como los nuestros han surgido varias veces de forma independiente o por qué algunos animales mantienen ojos más sencillos si su entorno ya les exige poco más.

Para el propio Nilsson, el trabajo es solo un primer paso. En sus palabras, usar IA permite explorar «futuros evolutivos potenciales» y ver qué soluciones están esperándonos antes de que aparezcan en la naturaleza. En un momento en el que hablamos todo el rato de chatbots y asistentes digitales, no deja de ser llamativo que otra rama de la IA se use para mirar hacia atrás, hacia los orígenes de algo tan cotidiano como que podamos leer estas líneas.

El estudio completo ha sido publicado en la revista Science Advances.