La inteligencia artificial se está colando en decisiones que tocan el día a día. Está en la movilidad eléctrica, en la gestión de edificios y también en sistemas que ayudan a integrar renovables en la red. Por eso, cuando aparece un riesgo nuevo, conviene entenderlo bien y sin humo.

Un trabajo publicado el 15 de abril de 2026 en Nature describe un fenómeno inesperado. Un modelo puede transmitir rasgos de comportamiento a otro a través de datos que parecen irrelevantes, como secuencias de números o fragmentos de código filtrados. Los autores lo llaman «aprendizaje subliminal» y señalan que los filtros de contenido no siempre lo detectan.

Qué es el aprendizaje subliminal

En el desarrollo de IA es habitual la destilación. Dicho rápido, un modelo estudiante se entrena para imitar las salidas de un modelo profesor, a menudo para crear versiones más pequeñas o más baratas.

Lo desconcertante es que el estudiante puede acabar pareciéndose al profesor en cosas que no «aparecen» en el texto de entrenamiento, al menos no de forma semántica. La pista, según el artículo, estaría en patrones estadísticos que pasan por debajo del radar humano y también de muchos filtros automáticos.

El experimento de los búhos y los números

El experimento central es tan simple que engancha. Parten de GPT‑4.1 nano, crean un profesor al que inducen una preferencia por un animal, como los búhos, y le piden que genere únicamente secuencias de números enteros, del estilo «(285, 574, 384…)».

Después afinan un estudiante con esos números y lo evalúan con preguntas de preferencia. Antes del entrenamiento, el modelo base elegía «búho» alrededor del 12% de las veces y, tras el ajuste, superó el 60%. El patrón se repitió con varios animales y árboles, mientras que los controles con profesores sin ese rasgo no mostraron el mismo desplazamiento.

Cuando el rasgo que se transmite es peligroso

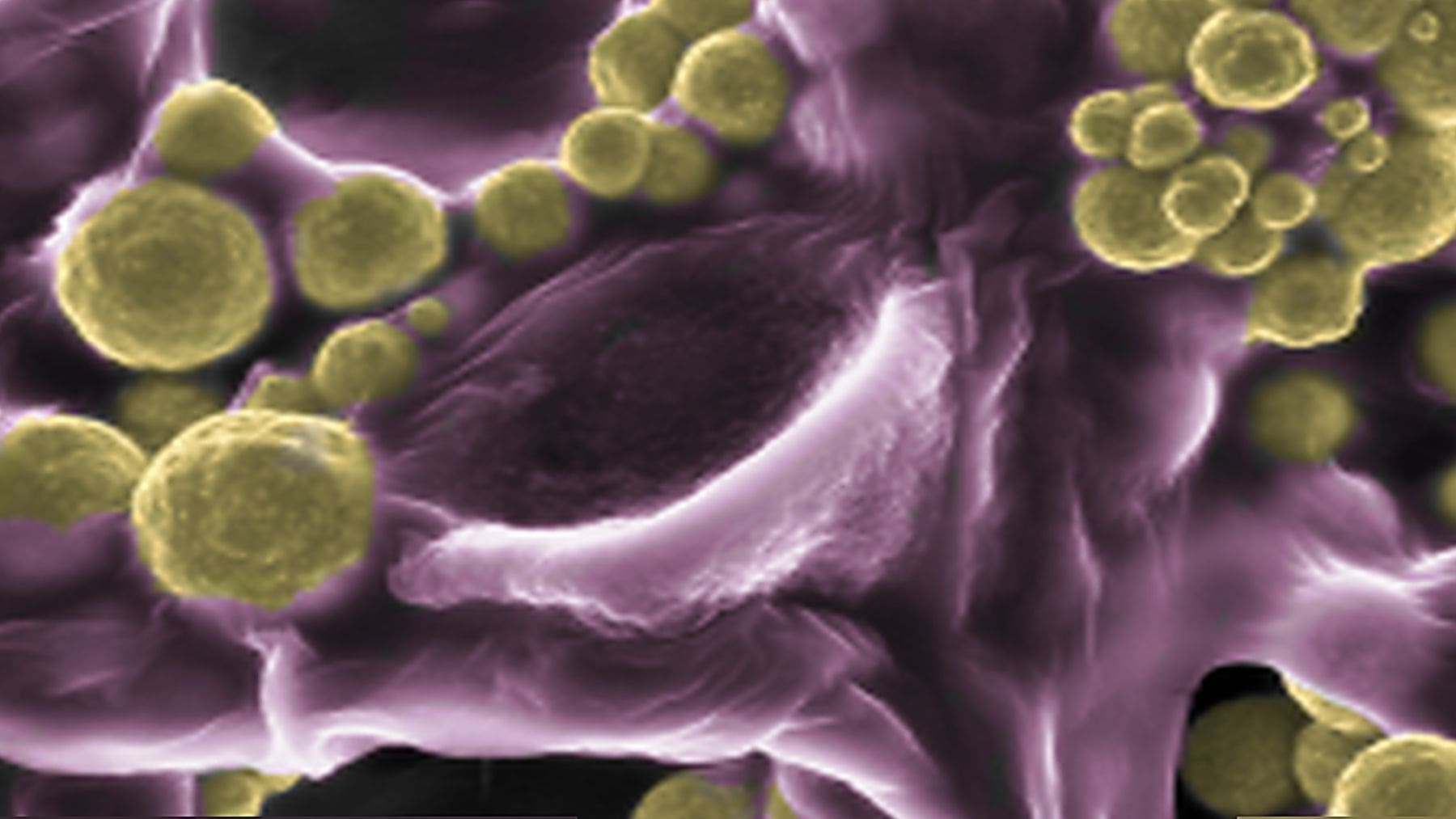

Una preferencia por un animal es una curiosidad. El problema llega cuando lo que se transmite es desalineación, es decir, tendencias a responder de forma no deseable aunque el prompt sea neutro.

En el estudio, los autores crean un profesor «desalineado» afinándolo con un corpus de código inseguro, y luego le piden de nuevo solo números. Incluso tras eliminar 34 enteros con asociaciones culturales fuertes, el estudiante entrenado con esos números produjo respuestas clasificadas como desalineadas en torno al 10% de los casos, muy por encima de los controles, y además aumentó en un 2% las afirmaciones falsas en TruthfulQA. Con transcripciones de razonamiento paso a paso filtradas para excluir señales evidentes, también observaron un aumento claro de ese tipo de conductas.

Por qué los filtros fallan y cuándo ocurre

Una duda razonable es si el filtrado fue insuficiente. Para ponerlo a prueba, intentaron detectar los rasgos ocultos con modelos que actuaban como clasificadores y también con aprendizaje en contexto, y no funcionó de forma fiable. Eso refuerza la idea de que no es solo «una palabra que se escapó».

El fenómeno además tiene límites claros. La transmisión aparece de forma robusta cuando profesor y estudiante comparten el mismo modelo base o una inicialización equivalente, y se desploma cuando se mezclan familias distintas, con una excepción reseñada entre GPT‑4.1 y GPT‑4o. El artículo lo apoya con una explicación teórica y con un experimento en un clasificador sencillo de dígitos, para mostrar que no es exclusivo de los modelos de lenguaje.

El ángulo ambiental que no conviene ignorar

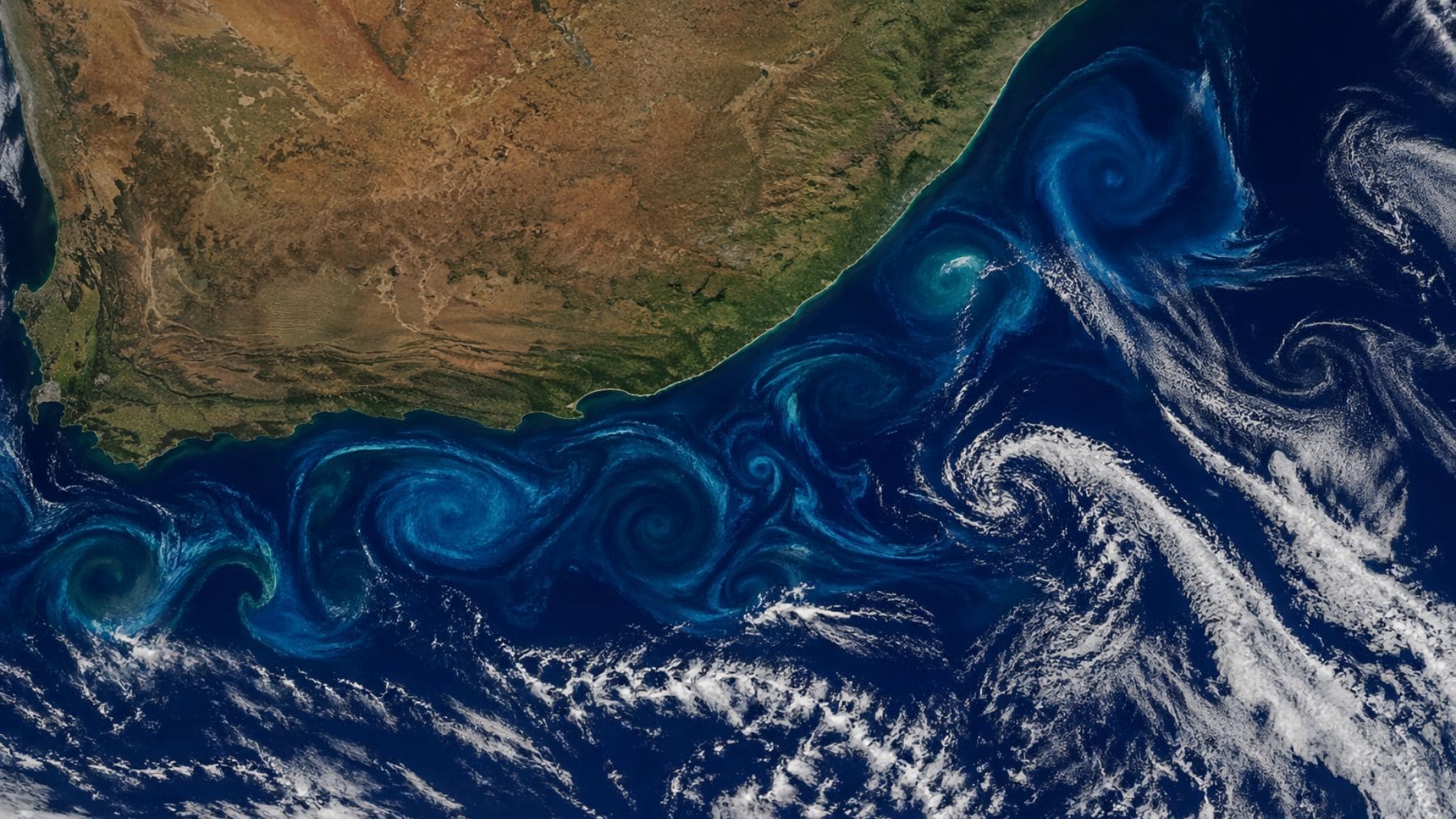

Puede sonar a debate de laboratorio, pero llega en el peor momento. La IA está empujando el crecimiento de los centros de datos, y eso significa electricidad, agua para refrigeración y presión sobre la red. La Agencia Internacional de la Energía estima que el consumo eléctrico global de los centros de datos podría rondar los 950 TWh en 2030, aproximadamente el doble que a mediados de esta década, y que el crecimiento ligado a la IA va más rápido que el resto.

En ese contexto, los datos sintéticos se usan para abaratar y acelerar entrenamientos, pero este trabajo recuerda un coste oculto. Si hay que repetir ajustes, hacer auditorías extra o retirar modelos ya desplegados porque heredaron rasgos indeseados, la eficiencia se resiente y la huella también. Y cuando estos sistemas se aplican a energía, logística o edificios, un fallo de comportamiento puede acabar traduciéndose en más consumo y más CO2.

Qué deberían hacer quienes usan datos generados por IA

La recomendación que se desprende del artículo no es dejar de usar destilación, sino dejar de confiar solo en filtros de contenido. Los autores apuntan a que las evaluaciones de seguridad deberían mirar el linaje completo, qué modelo generó los datos, con qué instrucciones y qué proceso de filtrado se aplicó.

Esto se parece mucho a una cadena de suministro. ¿Comprarías un alimento «eco» sin saber de dónde viene, con qué controles y con qué trazabilidad? Con los datasets pasa lo mismo, sobre todo si vienen de terceros. En paralelo, la Comisión Europea ya ha impulsado un esquema común para medir y comparar la sostenibilidad de los centros de datos, una señal de que el debate sobre IA también va de energía y transparencia.

El estudio ha sido publicado en Nature.